医院DeepSeek安全防御体系构建指南:从Ollama漏洞看智能诊疗系统风险治理

国产大模型DeepSeek在医疗领域的本地化部署呈现爆发式增长,短短一个月内就有上百家医院部署了DeepSeek。伴着这股劲风,大型语言模型快速进入了临床决策支持、电子病历分析、医学影像解读等核心场景。

然而,近期曝光的Ollama一系列高危漏洞(CVE-2024-39719/39720/39721/39722)为医疗机构敲响了警钟,该系列漏洞中,CVSS评分最高的8.2,最低的7.5分,均属于高危级别。国家网安部门数据显示,超过60%的Ollama用户因未及时更新系统而面临风险。

Ollama作为大模型本地部署的核心工具,因其便捷性成为DeepSeek部署的重要抓手——用户通过Ollama的RESTful API接口,可快速完成模型加载、推理服务配置等操作。数据显示,超过89%的DeepSeek-R1本地化部署案例依赖Ollama框架。

1 漏洞解剖:医疗AI系统的脆弱性图谱

DeepSeek广泛落地的背后,开源工具链的安全隐患逐渐浮出水面。Ollama的安全缺陷已导致多起医疗AI系统安全事故。医疗AI系统面临的三重安全困境:模型完整性危机、患者隐私泄漏风险、医疗决策可靠性威胁。

1.1 医疗系统服务瘫痪

黑客可通过漏洞发送特殊指令让医院服务器"宕机",从而引发相关系统瘫痪,医疗业务无法正常运转,甚至全面停摆。

1.2 模型资产失窃风险

攻击者通过未授权API访问,可在30秒内窃取价值百万的预训练医学模型。攻击者利用默认开放的11434端口,可以完整获取临床数据的微调参数。某企业就曾因此遭黑客入侵,30秒时间内被盗取了价值百万的AI模型。

1.3 诊疗决策污染威胁

通过恶意数据注入可系统性改变模型输出结果。例如:在测试环境中,攻击者将"阿司匹林禁忌症"参数篡改后,模型对消化道出血患者的用药建议错误率提升了43%。

1.4 隐私数据泄露链式反应

未受保护的通信链路可能成为HIPAA违规导火索。例如:2024年美国AI医疗公司Confidant Health的服务器配置错误,泄露了5.3TB的敏感心理健康记录,给众多用户带来困扰。

2 医疗AI场景下的安全风险自测

Ollama 0.1.47版本已经修复了该漏洞,如果你的版本低于0.1.47,请抓紧时间修补漏洞。

3 纵深防御体系构建方法论

在医疗AI系统面临多维度安全挑战的当下,构建纵深防御体系已成为守护患者安全、保障医疗服务连续性的战略防线。本方法论基于"基础设施-模型-监测"三重防护闭环,深度融合零信任架构与医疗合规要求,打造从网络边界到算法内核的全链路安全屏障。

3.1 基础设施防护层

网络隔离:基于零信任架构划分模型训练域、临床推理域,参照GB/T 43696-2024《网络安全技术零信任参考体系架构》。

端口管控:改造默认服务端口,参照国内规范《网络端口使用管理制度》。

传输加密:采用国密算法(SM2/SM4)及WAPI协议,如需兼容国际环境,需要同时兼容FIPS 140-2认证的量子安全通信协议。

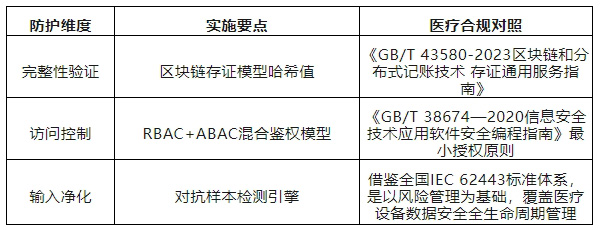

3.2 模型安全防护层

3.3 监测响应层

在监测响应层面,医院需要构建"基线-情报-熔断"的闭环防御机制。

首先通过持续采集模型正常状态下的特征权重分布、输出置信度等关键指标,建立动态更新的行为基线,运用SHAP值分析法监测特征权重波动。

其次,接入医院信息安全共享平台,密切关注AI系统安全风险。同时定期跟踪暗网交易、漏洞利用、异常访问等多源威胁情报网络,实现威胁特征实时更新。

最后,建立熔断机制。当检测到诊断建议离散度超过15%或监测指标突破预设阈值时,立即触发熔断机制,自动将异常模型隔离至沙箱环境,阻止错误决策影响临床系统,并向安全运营中心发送告警信息,形成"监测-决策-响应"的自动化防御链条。

4 医疗AI安全加固实践指南——三步筑牢安全防线

第一步:立即升级系统

在Windows和mac的OS上,Ollama系统都会自动下载更新;Liunx系统则需要手动执行命令完成Ollama系统更新:

第二步:设置安全屏障

任何陌生人来访,均需通过三道关卡:

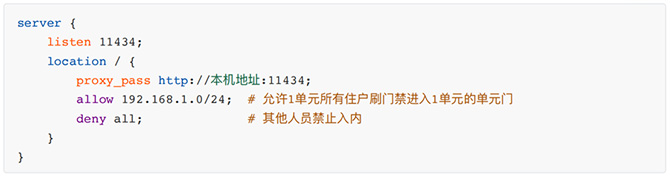

1. 网络隔离:使用防火墙让Ollama服务仅限内部访问。

2. 双重认证:添加白名单(门禁)和账号密码认证(门锁),本文使用Nginx作为示例,读者可根据实际情况自行调整。

2.1 设置"小区门禁"(IP白名单),就像给小区设置刷卡门禁,只允许指定IP访问:

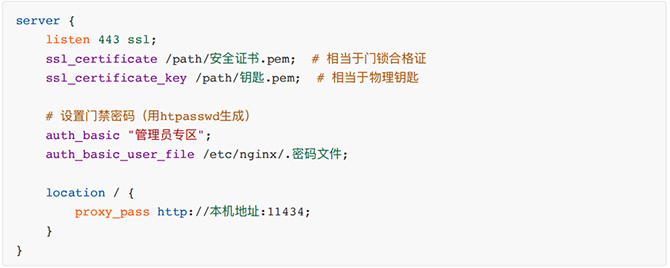

2.2 添加"双重门锁"(账号密码+HTTPS),相当于在防盗门再加密码锁:

配置小贴士:

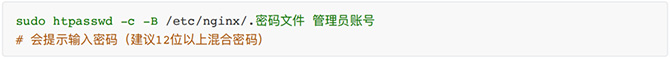

创建密码文件(在服务器执行):

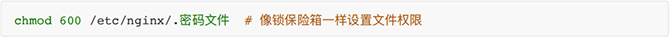

权限设置:

端口改造:修改默认11434端口为自定义端口,相当于把大家都知道的大门封住,只走自己知道的别的门。

修改Ollama配置文件(默认位于/etc/ollama/config.json),将默认的11434端口换成其他端口:

第三步:禁用危险功能(可选)

为医疗AI场景部署多重防护机制,给关键敏感操作上把"智能锁":

关闭模型上传/下载接口;

设置每分钟最多5次问答请求;

记录所有异常访问日志。

5 真实案例复盘与启示

某科技公司因致命疏忽未修改设备初始配置,相当于为黑客敞开数字世界的大门。攻击者仅通过最基础的端口扫描,便精准定位到暴露的11434高危端口——这道未设防的"电子城门"直通企业核心数据库。入侵者如入无人之境,不仅窃取了包含客户隐私和商业机密的完整对话记录,更通过注入恶意指令序列,使运行中的智能模型瞬间陷入"认知崩塌"状态,输出混乱数据导致生产系统全面瘫痪。这场精准网络打击造成的直接经济损失超过500万元,而事后安全审计揭示,仅需执行常规系统升级即可阻断99%的攻击路径,将损失扼杀于萌芽。

这起事件暴露出企业安全体系存在致命漏洞,本应固若金汤的数字堡垒,竟因基础防护的缺失沦为黑客的"提款机"。

6 构建全链路安全屏障,护航医疗AI稳健前行

漏洞是"照妖镜":Ollama事件折射出开源工具链的脆弱性,任何便捷性都可能伴随风险敞口,医疗机构需建立持续漏洞扫描与应急响应机制;

合规是"生命线":从零信任架构到区块链存证标准,医疗AI安全需与国家政策同频共振,将技术防护融入合规框架;

防御是"动态战":熔断机制、对抗样本检测等创新手段,需与威胁情报网络形成攻防闭环,构建自适应的安全进化能力。

在此呼吁全体医信同仁:

医疗机构应立即开展安全自查,实施端口改造与双重认证,升级Ollama至0.1.47版本以上,截至目前最新版本是0.6.2;技术厂商需强化模型鲁棒性测试,建立全生命周期风险管理;监管部门应加快制定医疗AI安全认证标准,形成"技术+管理+政策"三位一体防护网。唯有如此,方能让医疗AI真正成为提升诊疗效率的"智能助手",而非威胁患者安全的"数字炸弹"。

(作者单位:云南省肿瘤医院)

首 页

首 页